技术摘要:

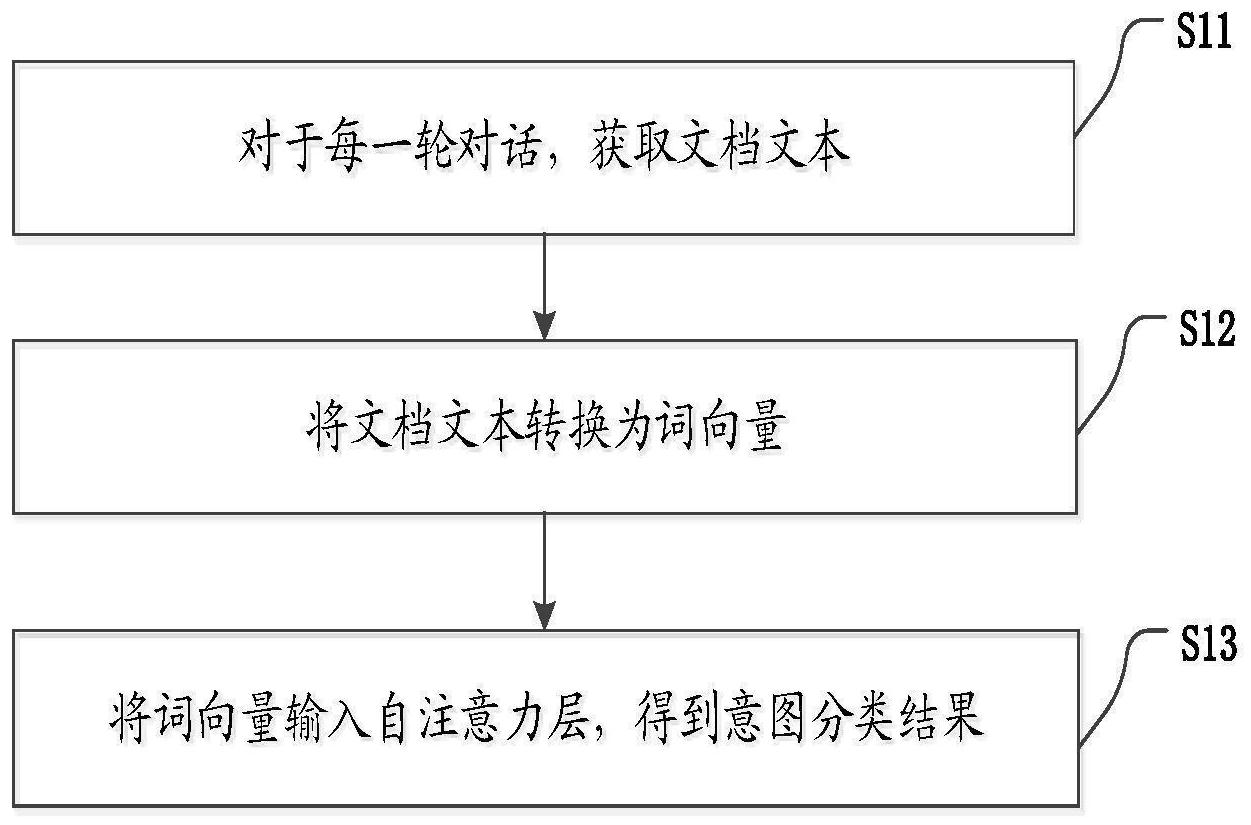

本发明公开了一种文档级多轮对话意图分类方法、装置、设备及存储介质,该方法包括:对于每一轮对话,获取文档文本;将文档文本转换为词向量;将词向量输入自注意力层,得到意图分类结果。该方法实现提高意图分类结果的准确性。

背景技术:

目前,单轮对话意图分类只能识别一次单轮对话,远不能满足实际的多轮对话的 工业应用,因此多轮对话文档级意图分类方法开始进入到了人们的视线当中。现有技术中, 文档级多轮对话意图分类方法一般采用非层次化双向LSTM模型来完成。参考图1,图1为现 有技术中非层次化双向LSTM模型图,首先,在每一轮对话中,将文档文本中每一个词信息输 入到词嵌入层,得到输出结果,将词嵌入层的所有输出结果输入到双向LSTM(Long Short- Term Memory,长短期记忆网络)层,得到双向LSTM层的输出结果,利用双向LSTM层的输出结 果得到意图分类结果。 然而,这种意图分类方法仅仅利用非层次化双向LSTM网络来完成意图分类,没有 考虑到上下文信息关联,意图分类结果的准确性较低。

技术实现要素:

本发明的目的是提供一种文档级多轮对话意图分类方法、装置、设备及存储介质, 以实现提高意图分类结果的准确性。 为解决上述技术问题,本发明提供一种文档级多轮对话意图分类方法,包括: 对于每一轮对话,获取文档文本; 将文档文本转换为词向量; 将词向量输入自注意力层,得到意图分类结果。 优选的,所述将文档文本转换为词向量,包括: 从文档文本中提取词信息; 将词信息进行向量转换,生成词向量。 优选的,所述将词信息进行向量转换,生成词向量,包括: 将词信息进行向量转换,得到词嵌入向量和位置嵌入向量; 将词嵌入向量和位置嵌入向量进行拼接,得到词向量。 优选的,所述自注意力层包括:句子级别自注意力层和对话级别自注意力层。 优选的,所述将词向量输入自注意力层,得到意图分类结果,包括: 对于每一轮对话,将词向量输入至每一轮对话对应的句子级别自注意力层,输出 得到句子级别隐状态; 将所有句子级别隐状态输入至轮次位置嵌入层,输出得到融合隐状态; 将融合隐状态输入至对话级别自注意力层,输出得到对话级别隐状态; 利用对话级别隐状态得到意图分类结果。 优选的,所述利用对话级别隐状态得到意图分类结果,包括: 3 CN 111597339 A 说 明 书 2/5 页 将对话级别隐状态输入至分类层,输出得到意图分类结果。 优选的,所述分类层为Softmax分类层。 本发明还提供一种文档级多轮对话意图分类装置,包括: 获取模块,用于对于每一轮对话,获取文档文本; 转换模块,用于将文档文本转换为词向量; 输入模块,用于将词向量输入自注意力层,得到意图分类结果。 本发明还提供一种文档级多轮对话意图分类设备,包括: 存储器,用于存储计算机程序; 处理器,用于执行所述计算机程序时实现如上任一项所述的文档级多轮对话意图 分类方法的步骤。 本发明还提供一种计算机可读存储介质,所述计算机可读存储介质上存储有计算 机程序,所述计算机程序被处理器执行时实现如上任一项所述的文档级多轮对话意图分类 方法的步骤。 本发明所提供的一种文档级多轮对话意图分类方法、装置、设备及存储介质,对于 每一轮对话,获取文档文本;将文档文本转换为词向量;将词向量输入自注意力层,得到意 图分类结果。可见,每一轮对话中,将转换后的词向量输入自注意力层,利用自注意力层来 获取意图分类结果,这样不再通过非层次化双向LSTM网络来完成意图分类,而是利用层次 化自注意力来完成意图分类,由于采用了自注意力机制并且层次化,这样能够考虑到上下 文信息关联,更好的抽取文档级本文数据中的信息,结合多轮对话中的上下文信息进行预 测,意图分类结果的准确性较高,实现提高意图分类结果的准确性。 附图说明 为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现 有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本 发明的实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据 提供的附图获得其他的附图。 图1为现有技术中非层次化双向LSTM模型图; 图2为本发明所提供的一种文档级多轮对话意图分类方法的流程图; 图3为词向量生成过程图; 图4为层次化自注意力模型架构图; 图5为本发明所提供的一种文档级多轮对话意图分类装置结构示意图; 图6为本发明所提供的一种文档级多轮对话意图分类设备结构示意图。