技术摘要:

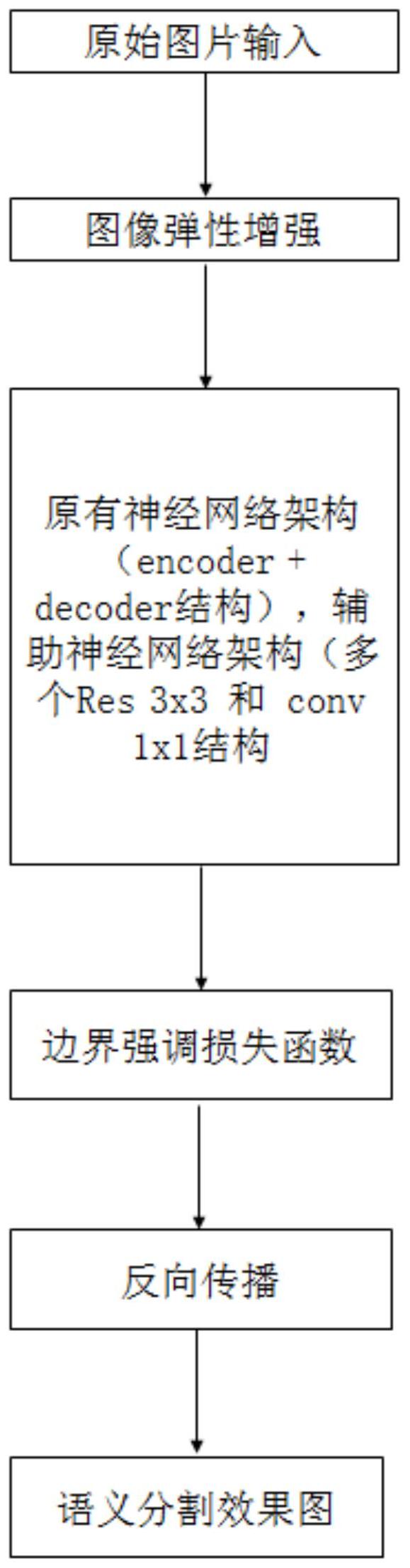

本发明公开了基于双流架构和边界强调损失函数的可行驶区域分割方法,包括S1输入原始图片;S2将原始图片分别输入主网络及辅助网络,将两个网络得到的输入特征图进行融合得到最终数据特征图;S3添加边界强调损失函数对最终数据特征图的损失进行描述,得到目标图像与标注 全部

背景技术:

人工智能技术已经融入了各行各业并且带来了全新的突破,而人工智能和汽车行 业的融合带动着自动驾驶技术进入新的领域。自动驾驶技术由系统需求、系统架构、软件需 求、软件架构、软件开发、集成测试、功能安全等六大板块共同构成,其中最核心部分为软件 开发中的算法开发。自动驾驶算法开发部分又可以划分为车外环境感知算法、驾驶决策仲 裁算法、车辆底层控制算法和车内驾驶员监测算法。 由于车外环境感知处于整个算法流程最上游,且与人工智能技术紧密结合,因此 车外环境感知算法是整个自动驾驶技术中最为核心算法模块。又由于车外环境受天气、工 况、场景等影响非常大,因此使用传统方法进行环境感知较为困难。业界使用前视摄像头、 毫米波雷达、激光雷达、超声波雷达等传感器对外界环境进行探测和结构化数据输出。由于 前视摄像头的拟人程度最高,且图像数据包含丰富的纹理、颜色、轮廓等信息,因此基于前 视摄像头的图像特征数据提取和描述占据非常重要的位置。 基于前视摄像头图像的特征数据提取包括含可行驶区域的语义分割、多目标检 测、车道线检测拟合和多目标跟踪。由于语义分割能够提供像素级别的图像特征预测,在所 有特征数据提取方法中最能够细致的表征特征,因此语义分割处于前视摄像头图像特征数 据提取流程的最上游,后续如多目标检测可与语义分割检测效果进行联合数据冗余。 由于当前语义分割误差点主要集中于不同实例的边界处,即核心难点处在形状边 界判定处,因此本发明提供一种基于双流架构和边界强调损失函数的可行驶区域分割方 法。

技术实现要素:

为了克服现有技术存在的缺点与不足,本发明提供一种基于双流架构和边界强调 损失函数的可行驶区域分割方法。 本发明采用如下技术方案: 一种基于双流架构和边界强调损失函数的可行驶区域分割方法,包括如下步骤: S1输入原始图片; S2将原始图片分别输入主网络及辅助网络,将两个网络得到的输入特征图进行融 合得到最终数据特征图; S3添加边界强调损失函数对最终数据特征图的损失进行描述,得到目标图像与标 注数据之间的损失值; S4反向传播法将损失值进行回传; S5得到最终的语义分割效果图。 3 CN 111582279 A 说 明 书 2/4 页 所述S1输入原始图像后,还包括图像弹性增强步骤。 所述主网络为当前的语义分割神经网络框架ENet,该框架为对称性的encoder decoder框架。 所述辅助网络包括基础残差神经网络模块Res 3x 3和基础直通神经网络模块 Conv 1x 1。 现有损失函数是每个像素与标注数据进行比较,通过交叉熵来计算误差,所述边 界强调损失函数是在交叉熵加上L2正则表达项来计算误差。 所述最终的语义分割效果图与原始输入图像的长宽尺寸相同,通道数为类别数。 所述图像弹性增强包括镜像、翻转、旋转、添加高斯噪声、添加椒盐噪声、白化及归 一化。 在encoder部分的神经网络VGG模型参数量为1.2亿,每个参数表示每个神经元的 权值。 作为辅助神经网络架构的部分模型参数量为800万。 所述将原始图片分别输入主网络及辅助网络,具体是主网络的每一层卷积特征图 分别是辅助网络的基础残差神经网络模块及主网络当前层的下一层的输入。 本发明的有益效果: (1)本发明针对现有神经网络不能精细切割实例的问题,在原有单线处理操作的 基础上添加了辅助架构,后两个神经网络架构进行数据融合,使得不同实例的切割能够更 加精细化。 (2)针对语义分割边界不够平滑这一问题,本发明提出一种新的损失函数,与传统 损失函数相比,本提案提出的损失函数能够对边界进行强调,对边界预测不平滑的地方进 行损失惩罚,使得预测效果能够更加平滑。 附图说明 图1是本发明的工作流程图; 图2是本发明中主网络及辅助网络的连接示意图。