技术摘要:

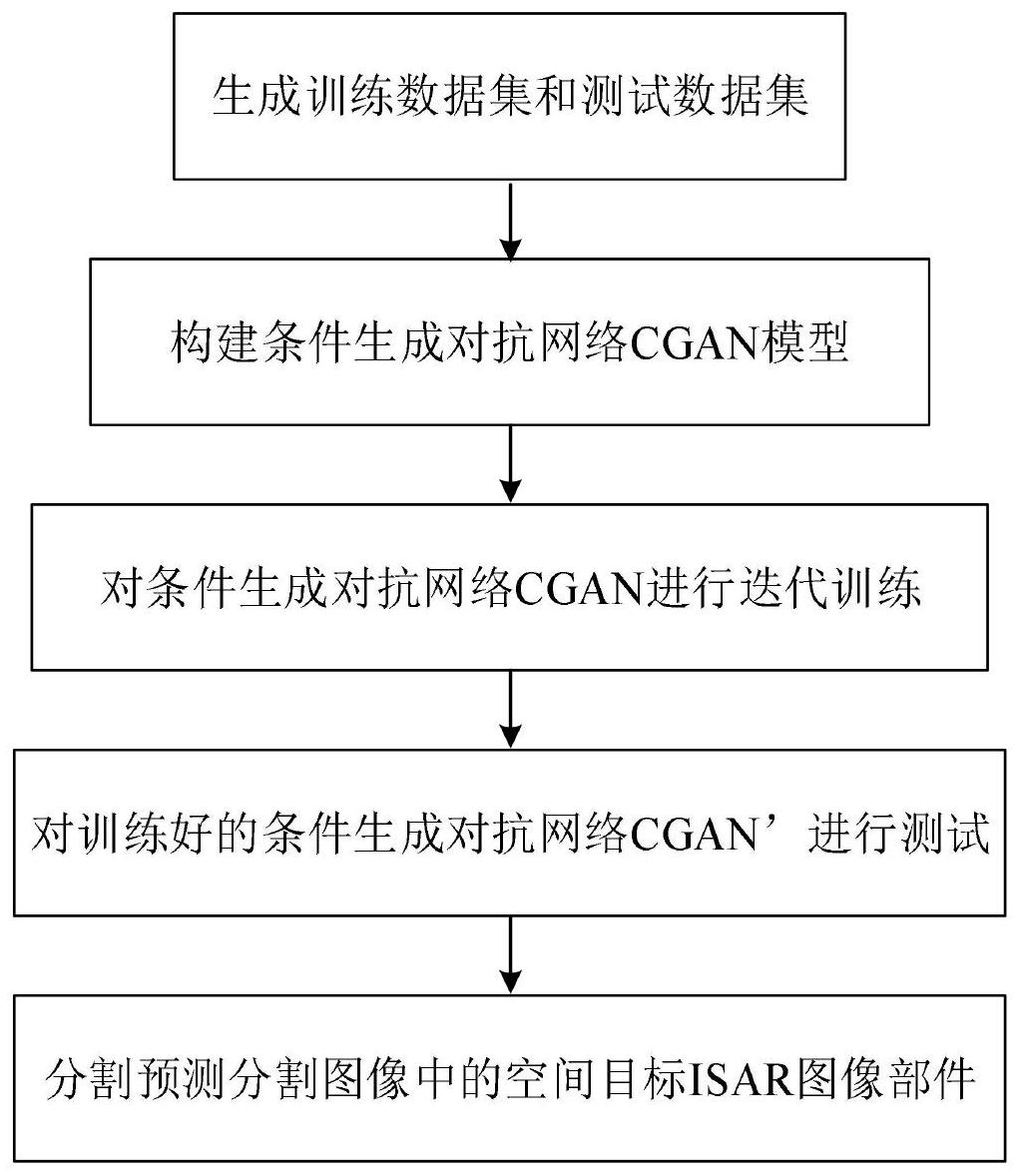

本发明提出了一种基于条件生成对抗网络CGAN的空间目标ISAR图像部件分割方法,用于解决现有技术存在的ISAR图像分割精度低的问题,实现步骤为:生成训练数据集和测试数据集;构建条件生成对抗网络CGAN模型;对条件生成对抗网络CGAN进行迭代训练;对训练好的条件生成对抗 全部

背景技术:

逆合成孔径雷达(ISAR,Inverse Synthetic Aperture Radar)是合成孔径雷达发 展过程中的一个重要分支,具有全天时、全天候和远距离成像的能力。随着全球各国对太空 资源逐步重视,对太空资源的开发已经成为热点,并且今后太空作战的趋势逐步加剧,空间 目标已经成为了雷达领域的研究热点,通过对获取的空间目标ISAR图像进行分析可以实现 对空间目标的类型、尺寸、材料甚至危险度的判定,利用ISAR图像对空间目标姿态估计与空 间目标识别技术也成为太空智能化武器系统研究的重点任务和关键技术。利用ISAR图像实 现空间目标姿态估计或空间目标识别的关键是利用ISAR图像获得空间目标的外形、主体指 向、和部件尺寸等特征,首先需要提取空间目标的ISAR图像部件,即实现空间目标ISAR图像 部件分割,因此,空间目标ISAR图像部件分割技术具有很重要的研究价值。 图像分割是指根据一定的相似性准则将图像划分成不同区域的过程,是后续图像 处理的基础。传统的图像分割方法主要包括阈值法、边界检测法、区域法等,这些方法的实 现原理有所不同,但基本都是利用图像的低级语义,包括图像像素的颜色和纹理等信息,对 噪声比较敏感,遇到复杂场景时实际分割效果不尽理想。 目前,深度学习发展迅猛,深度学习技术在图像分割领域也取得了一系列突破性 进展。基于深度学习的图像分割方法通过为图像中的每个像素分配一个预先定义的表示其 语义目标类别的标签,更多地结合了图像本身提供的中高层语义信息完成图像分割,适用 范围更广。深度图像分割方法中最典型的模型是基于候选区域的图像分割方法,此类方法 首先从原始图像中选取候选区域,然后对候选区域进行特征提取,最后对每个候选区域进 行语义分类并根据分类结果在原始图像上进行标注,最终得到图像分割结果。但基于候选 区域的图像分割方法生成候选区域耗时较长,影响算法性能,并且生成的候选区域质量直 接影响到算法的效果,此类方法无法完成端到端的图像分割。近些年来,一些学者提出了对 像素直接分类的端到端的图像分割方法。Long等人于2014年提出了FCN (f ully convolutional network)方法,设计了一种针对任意大小的输入图像,训练端到端的全卷 积网络的框架,通过双线性插值上采样和组合中间层输出的特征图的方法实现了像素级分 类。以上方法大都是针对于光学图像的分割方法,不同于光学图像,ISAR图像特有的相干斑 效应、旁瓣干扰等,使得以上分割方法处理ISAR图像时得到分割结果的分割精度并不理想。 申请公布号为CN110910413A,名称为“一种基于U-Net的ISAR图像分割方法”的专利申请,公 开了一种ISAR图像分割方法,采用编码器-解码器的网络结构,先下采样学习ISAR图像的深 层特征,特征图再经过上采样恢复为输入ISAR图像大小后进行分类。该网络中,较浅的层用 来解决像素定位问题、较深的层用来解决像素分类问题,从而消除ISAR图像相干斑效应、旁 5 CN 111583276 A 说 明 书 2/7 页 瓣的影响,提高了ISAR图像的分割精度。该方法虽然充分利用了ISAR图像的空间位置信息, 但该模型学习到的只是ISAR图像中每个像素点到其标签的映射关系,即只学习了局部映射 关系,并不能学习到全局的映射关系,因此,ISAR图像分割精度仍然较低。

技术实现要素:

本发明的目的在于针对上述现有技术存在的不足,提出了一种基于CGAN的空间目 标ISAR图像部件分割方法,用于解决现有技术存在的空间目标ISAR图像部件分割精度低的 问题。 为实现上述目的,本发明采取的技术方案包括如下步骤: (1)生成训练数据集和测试数据集: (1a)对从空间目标ISAR图像数据集中随机选取的M幅ISAR图像中的太阳能帆板与 主体进行像素级标记,并对标记后的每个带真实标签的ISAR图像进行上、下、左、右、左上、 左下、右上和右下八个方向平移,得到M×8个带真实标签的平移ISAR图像; (1b)对每个带真实标签的ISAR图像,以及每个带真实标签的平移ISAR图像进行水 平镜像、垂直镜像和对角镜像,并将M个带真实标签的ISAR图像、M×8个带真实标签的平移 ISAR图像及其(M M×8)×3个带真实标签的镜像ISAR图像作为训练数据集,其中M≥300; (1c)从空间目标ISAR图像数据集中随机选取N幅ISAR图像组成测试数据集,其中, 100≤N≤200; (2)构建条件生成对抗网络CGAN模型: 构建包含生成器子网络G和判别器子网络D、损失函数为LCGAN的条件生成对抗网络 CGAN模型,其中:生成器子网络G包括由多个卷积层组成的编码器、跳线层、由多个卷积层组 成的解码器、预测层,G的损失函数为Lg;判别器子网络D包括多个卷积层、判别层,D的损失 函数为Ld; (3)对条件生成对抗网络CGAN进行迭代训练: (3a)设迭代次数为q,最大迭代次数为Q,Q≥200,并令q=0; (3b)采用正态分布随机点对生成器子网络G和判别器子网络D的权值进行随机初 始化,同时对生成器子网络G和判别器子网络D的偏置初始化为0,得到初始化后的生成器子 网络Gq和判别器子网络Dq; (3c)固定判别器子网络Dq,训练生成器子网络Gq: (3c1)从训练数据集中随机选取m个带真实标签的ISAR图像输入生成器子网络Gq, 并通过所计算的G的损失函数Lg的值对生成器子网络Gq进行训练,得到m个预测标签Gq(xi), 其中m≥10000,i=1,2,...,m; (3c2)将m个带真实标签ISAR图像中的每一幅ISAR图像与其真实标签拼接得到m个 拼接图像,同时将m个带真实标签的ISAR图像中的每一幅ISAR图像与其预测标签拼接得到m 个预测拼接图像,并将m个拼接图像和m个预测拼接图作为判别器子网络Dq的输入进行预 测,得到2m个预测结果Dq(xi,yi)和Dq(xi,G(xi)); (3c3)使用步骤(3c1)中训练得到的m个预测标签和步骤(3c2)中预测得到的2m个 预测结果,采用梯度下降法通过所计算的条件生成对抗网络CGAN损失函数LCGAN的值对生成 器子网络Gq各层的参数进行更新,得到更新后的生成器子网络Gq 1; 6 CN 111583276 A 说 明 书 3/7 页 (3d)固定生成器子网络Gq 1,训练判别器子网络Dq: (3d1)将m个带标签的ISAR图像输入生成器子网络Gq 1,得到m个预测标签Gq 1(xi); (3d2)将m幅ISAR图像和其对应的真实标签拼接得到m个拼接图像,此m个拼接图像 的标签均为1,将m幅ISAR图像和其对应的预测标签拼接得到m个预测拼接图像,此m个预测 拼接图像的标签均为0;将m个拼接图像和m个预测拼接图像输入判别器子网络Dq,计算损失 值Ld并通过损失值Ld对判别器子网络Dq进行训练,得到2m个预测结果Dq(xi ,yi)和Dq(xi ,G (xi)); (3d3)使用步骤(3d1)中m个预测标签Gq 1(xi)、步骤(3d2)中的2m个预测结果Dq(xi, yi)和Dq(xi,G(xi))计算条件生成对抗网络CGAN的损失函数LCGAN的值,并采用梯度下降法通 过所计算的LCGAN的值对判别器子网络Dq各层的参数进行更新,得到更新后的判别器子网络 Dq 1; (3e)判断q=Q是否成立,若是,得到训练好的条件生成对抗网络CGAN’,否则,令q =q 1,并执行步骤(3c); (4)对训练好的条件生成对抗网络CGAN’进行测试: 将测试数据集中的N幅ISAR图像作为训练好的条件生成对抗网络CGAN’的输入进 行分割,得到N幅ISAR图像对应的N个预测分割图像; (5)分割预测分割图像中的空间目标ISAR图像部件: 设分割N个预测分割图像中的太阳能帆板与主体时的阈值均为δ,采用阈值分割法 分别分割出每个预测分割图像中的太阳能帆板和主体,将得到的太阳能帆板和主体作为空 间目标ISAR图像分割结果。 本发明与现有技术相比,具有如下优点: 本发明采用条件生成对抗网络CGAN对空间目标ISAR图像部件进行分割,CGAN将 ISAR图像作为条件信息输入生成器子网络G和判别器子网络D,通过生成器子网络G和判别 器子网络D的交替训练,即首先固定判别器子网络D,训练生成器子网络G;再固定生成器子 网络G,训练判别器子网络D,这种对抗博弈过程最终使条件生成网络CGAN预测的概率分布 接近真实概率分布,即G和D的交替训练实现了从ISAR图像到标签的全局映射,同时也可以 很好地构建预测分割图像的高频成分,使预测分割图像和标签尽量的轮廓细节相似。本发 明还采用L1损失作为LCGAN损失函数的一项,构建预测分割图像的低频成分,使预测分割图像 和标签的整体相似。仿真结果表明,本发明与现有技术相比,ISAR图像分割精度提高了 4.01%。 附图说明 图1是本发明的实现流程图; 图2是本发明生成器子网络示意图; 图3是本发明判别器子网络示意图; 图4为本发明与现有技术的分割精度仿真结果对比图;